El 8 de març ens recorda que la igualtat de gènere continua sent un repte en tots els àmbits, inclosa la tecnologia. La intel·ligència artificial, present en la nostra vida quotidiana, reflecteix les desigualtats de la societat que la desenvolupa. La IA és una eina que ha arribat per quedar-se, utilitzada diàriament per milers de persones que la consideren una font d’ajuda i informació sobre qüestions tant professionals com personals.

En una societat cada cop més influenciada pel seu ús, no són poques les persones que posen en dubte el seu correcte funcionament i la seva suposada perfecció.

Per comprendre com es desenvolupa la IA, cal entendre el seu funcionament de manera simplificada: els sistemes d’intel·ligència artificial aprenen a partir de grans volums de dades, identifiquen patrons i, amb aquesta informació, fan prediccions o prenen decisions sense necessitat de ser programats de manera explícita per a cada situació. Tanmateix, precisament en aquest procés d’aprenentatge automàtic resideix un dels principals reptes ètics i socials d’aquesta tecnologia: la perpetuació de les desigualtats.

La IA en l’àmbit professional i la manca de dones en el seu desenvolupament

La intel·ligència artificial ja és present en el nostre dia a dia, en processos de selecció de personal, diagnòstics mèdics o sistemes de seguretat, entre d’altres. Tanmateix, estudis com “La dona en la intel·ligència artificial: com la IA està perpetuant les bretxes de gènere preexistents” de Paula López Zamora adverteixen que no és neutral: “La IA podria haver-se convertit en un aliat magnífic de la igualtat de gènere, però una anàlisi de la realitat actual ens mostra com les tecnologies més avançades continuen construint imaginaris i realitats sexistes”.

Així mateix, ho recull l’“Informe preliminar amb perspectiva interseccional sobre biaixos de gènere en la intel·ligència artificial”, elaborat el 2023 per l’Institut de les Dones, que subratlla que els algoritmes no actuen de manera equitativa: reprodueixen els valors i les jerarquies existents en la societat. Si no s’incorporen criteris d’igualtat des de la seva creació, la IA pot perpetuar estereotips i generar efectes discriminatoris significatius.

Un exemple rellevant és el de la selecció de personal: alguns sistemes de cribratge automatitzat han penalitzat currículums de dones en associar el lideratge amb trajectòries masculines, reproduint patrons històrics de contractació dominats per homes.

Una de les claus d’aquest problema resideix en la manca de diversitat en el sector. Segons el Fòrum Econòmic Mundial, només al voltant del 22 % de les persones que treballen en intel·ligència artificial són dones. L’Institut de les Dones i organismes com la UNESCO han advertit que aquesta infrarepresentació limita la pluralitat d’enfocaments i dificulta la incorporació d’una perspectiva de gènere en el disseny dels algoritmes.

D’aquesta manera, la reduïda presència femenina no només constitueix una desigualtat dins del sector tecnològic, sinó que influeix directament en com es desenvolupen sistemes que impacten en l’ocupació i en altres àmbits de la vida social.

Dones referents en el sector

Les dones estan deixant una empremta decisiva en la tecnologia i la intel·ligència artificial, liderant avenços clau en el sector. Històricament poc reconegudes, avui els seus èxits inspiren noves generacions i consoliden el seu paper com a referents imprescindibles en la ciència i la innovació.

Som moltes les persones que hem sentit parlar de Mira Murati, una de les principals responsables de ChatGPT i figura clau a OpenAI, però no és l’única dona que deixa empremta en la intel·ligència artificial; el seu exemple ens recorda la importància de visibilitzar totes les persones que lideren avenços en el sector:

Gemma Galdon: Experta en ètica tecnològica i auditoria d’algoritmes

És experta en ètica tecnològica i auditoria d’algoritmes, i fundadora de Eticas.ai. Gràcies a la seva experiència multidisciplinària en l’impacte social, ètic i legal de la tecnologia intensiva en dades, ella i el seu equip dissenyen i implementen solucions pràctiques per afrontar els reptes de protecció de dades, ètica, explicabilitat i biaixos en IA.

Joy Buolamwini: Liderant una IA més justa i responsable

Informàtica i fundadora de la Algorithmic Justice League, dedicada a promoure l’equitat en la intel·ligència artificial. La seva recerca sobre biaixos en el reconeixement facial, especialment en rostres de pell fosca, ha estat clau per conscienciar sobre la importància de la transparència i la responsabilitat en la IA, influint en noves polítiques i normatives ètiques.

Nuria Oliver: Defensora de l’ètica i els valors humans en la IA

Directora científica de dades a Vodafone Group i una de les espanyoles més reconegudes internacionalment en intel·ligència artificial. Defensora de l’ètica i els valors humans en la IA, també ha treballat a Telefónica i col·labora amb Data-Pop Alliance, impulsant iniciatives que busquen augmentar la presència de dones en enginyeria i ciència de dades.

Karina Gibert: Veu destacada en la igualtat de gènere en tecnologia

Enginyera informàtica i catedràtica a la Universitat Politècnica de Catalunya, on dirigeix el centre de recerca IDEAI-UPC. Gibert és una veu destacada en ètica de la IA i igualtat de gènere en tecnologia, a més de ser assessora al comitè CETRA. Reconeguda per Forbes entre les 100 dones més influents de Catalunya i guardonada amb la Medalla d’Honor del Parlament, representa un referent clau de la IA en l’àmbit català.

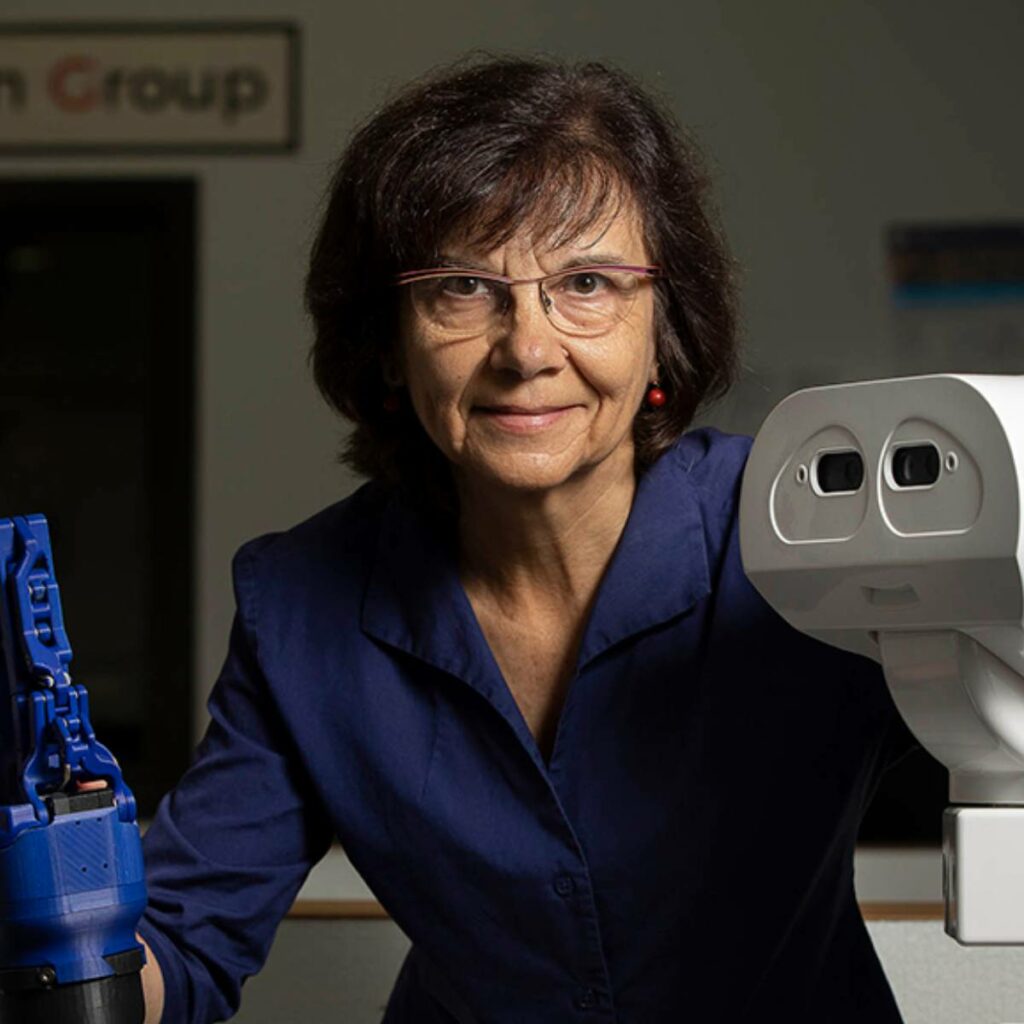

Carme Torras: Doctora en Informàtica i autora de novel·les de ciència-ficció

Doctora en Informàtica per la Universitat Politècnica de Catalunya (UPC) i llicenciada en Matemàtiques per la Universitat de Barcelona (UB). Ha dirigit projectes de recerca en robòtica assistencial, combinant la tecnologia amb la promoció de l’ètica en la seva aplicació. A més de la seva trajectòria científica, és escriptora i autora de novel·les de ciència-ficció relacionades amb la robòtica i la intel·ligència artificial.